A Intel lançou o Gaudi 3, um novo acelerador para treinamento de modelos de IA generativa em empresas. Em comparação com o rival Nvidia H100, a Intel afirma que o Gaudi 3 é 50% mais rápido no treinamento de LLMs como o Llama 2; tem uma inferência 30% mais veloz; e consumo de energia 40% mais eficiente. O novo acelerador estará disponível a partir deste segundo trimestre para OEMs como Dell, Lenovo, HPE e Supermicro.

Depois de uma fase com muitas provas de conceito (PoCs), grandes companhias ao redor do mundo começam a implementar projetos de treinamento de seus próprios modelos de IA generativa, o que requer servidores com aceleradores adequados para essa finalidade. Esse é o mercado alvo para o Gaudi 3. Bosch, IBM, Bharti Airtel e outras estão em sua lista de potenciais clientes para o novo acelerador.

Uma pesquisa apresentada pela Intel aponta que o mercado corporativo vai investir US$ 50 bilhões em IA generativa no mundo em 2024, e US$ 151 bilhões em 2028. E a maior barreira para implementação de LLMs corporativos tem sido o custo de infraestrutura, citada por 46% das empresas entrevistadas, informa a mesma pesquisa.

Plataforma aberta para IA corporativa

Junto com o anúncio do Gaudi 3, a Intel se comprometeu, ao lado de outros fornecedores, a implementar uma plataforma aberta para IA corporativa. Seus parceiros nesse projeto são: Anyscale, Articul8, DataStax, Domino, Hugging Face, KX Systems, MariaDB, MinIO, Qdrant, RedHat, Redis, SAP, VMware, Yellowbrick e Zilliz.

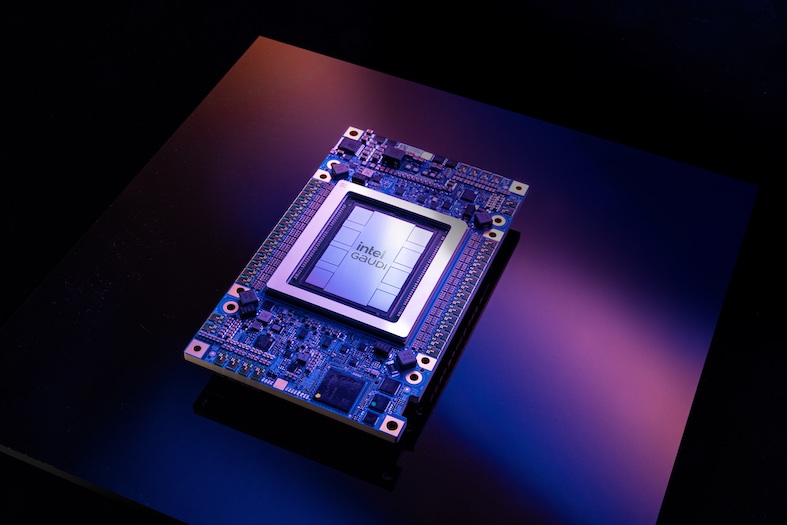

Imagem no alto: divulgação